Gemini query parametrelerini desteklemediği için prompt metni panonuza kopyalandı. Gemini sayfasında yapıştırabilirsiniz.

Uzun yıllardır SEO dünyasında yer alıyorum ve bu yolculukta edindiğim en değerli derslerden biri, Google’ın çalışma mantığının ardındaki gizemleri çözmek oldu… bugün ele alacağımız konu, görünürde teknik ve karmaşık olsa da aslında sitenizin genel sağlığı hakkında çok şey söyleyen bir kavram olan; tarama bütçesi yani Google’ın makinelerini ne kadar yorduğunuzun kapsamlı anlatısıdır.

Siz de benim gibi düşünebilirsiniz: “Googlebot, sitemdeki tüm sayfaları tarayıp indekslemiyor. Acaba sorun ne?” İşte bu gibi sorunlarda en temelde tarama bütçesi konusuna inmek gerekiyor. Bu kavramı zihninizde daha iyi canlandırmanız için size bir metafor sunmak isterim. Sitenizi, yüzlerce değerli eserin sergilendiği dev bir müze olarak düşünün. Googlebot ise bu müzeyi ziyarete gelen bir sanat eleştirmeni olsun. Ancak eleştirmenin sınırlı bir zamanı ve enerjisi var, yani her odaya, her koridora ve her esere aynı süreyi ayıramaz. Bu nedenle, en değerli eserleri ve ana sergileri hızlıca keşfetmesini sağlamak için ona iyi bir harita vermeniz, müzeyi mantıklı bir şekilde düzenlemeniz ve ilgisini dağıtacak gereksiz alanlardan kaçınmanız gerekir.

Bu makalede amacım, size sadece tarama bütçesinin ne olduğunu anlatmak değil, aynı zamanda size, Googlebot‘u sitenizin en değerli “eserlerine” nasıl yönlendireceğinizi öğretecek bir rehber sunmak olacak. Sadece temel bilgileri değil, aynı zamanda log analizi gibi ileri düzey teknikleri de ele alarak, bu konudaki bilgi birikiminizi en üst seviyeye taşıyacağım.

Tarama Bütçesi Nedir?

Tarama bütçesi, arama motorlarının bir web sitesinde belirli bir zaman diliminde tarayacağı URL sayısını ifade eden bir terimdir. Basitçe, Google’ın sitenize ayırdığı zaman ve kaynak limitidir. Bu bütçe sadece web sayfalarını değil, aynı zamanda CSS, JavaScript ve resimler gibi diğer tüm dokümanları da kapsar. Bu bütçenin doğru bir şekilde kullanılması, yeni eklenen veya güncellenen sayfaların arama motoru dizinine daha hızlı girmesi için kritik öneme sahiptir.

Google’ın bir siteye ayıracağı tarama bütçesini belirlerken kullandığı iki ana bileşen vardır:

- Tarama Hızı (Crawl Rate): Bu, Googlebot’un sitenize istek gönderebileceği maksimum frekanstır. Temelde, sunucunuzun Googlebot’un isteklerini ne kadar hızlı ve sorunsuz bir şekilde karşılayabildiğiyle ilgilidir. Sunucu yanıt süreleriniz ne kadar düşükse, Googlebot o kadar çok sayfayı kısa sürede tarayabilir. Sunucunuz yavaş yanıt verdiğinde veya hata döndürdüğünde, Googlebot sitenizi aşırı yüklememek için tarama hızını yavaşlatır, bu da önemli sayfalarınızın gözden kaçmasına neden olabilir.

- Tarama Talebi (Crawl Demand): Bu, Google’ın sitenizi ne kadar sıklıkta ve ne kadar derinlemesine taramak istediğiyle ilgilidir. Bir sitenin popülaritesi, aldığı linklerin kalitesi, içeriklerin güncellenme sıklığı ve genel içeriğin kalitesi, Google’ın tarama talebini doğrudan etkiler. Siteniz ne kadar popüler ve güncelse, Google’ın ona olan “talebi” de o kadar artar.

Eskiden sırf bu talebin hızlanması (Index alma süresini kısaltmak için) Google News kaydı yapılırdı, fakat Google bunun önüne geçerek News haber akışında direkt yer edinmek isteyen web sitelerinin önüne geçti…

Crawl Limit ve Crawl Rate Faktörlerini Anlamak

Crawl limit, arama motorlarının web sitenizden sayfa isteğinde bulunabileceği maksimum sıklığı ifade eder. Bu sınır, sunucu performansını olumsuz etkilemeden belirlenir ve şu teknik faktörlere bağlıdır:

- Sunucu yanıt süreleri

- Barındırma (hosting) altyapısının kalitesi

- Web site mimarisinin (architecture) karmaşıklığı

Arama motorları, uygun crawl rate değerini belirlemek için sunucu yanıt düzenlerini sürekli izler.

- Hızlı ve güvenilir sunuculara sahip siteler, genellikle daha yüksek crawl limit alır.

- Yavaş yanıt süreleri veya sık hata veren sitelerde ise tarama aktivitesi düşer.

Bu durum, teknik performans ile crawl budget dağılımı arasında doğrudan bir ilişki oluşturur.

Crawl budget optimizasyonu, hem crawl rate sınırlamalarını hem de crawl demand (tarama talebi) faktörlerini dikkate almalıdır.

- Sunucu performansını iyileştirmek

- Veritabanı sorgularını optimize etmek

- Etkili önbellekleme (caching) mekanizmaları uygulamak

gibi adımlar, crawl limitinizi artırarak arama motorlarının içeriğinizi daha sık keşfetmesini ve dizine eklemesini sağlar.

Crawl Budget Neden SEO İçin Önemlidir?

Crawl budget optimizasyonu özellikle şu durumlarda kritik öneme sahiptir:

- Büyük web siteleri – Binlerce veya milyonlarca sayfaya sahip siteler (örn. e-ticaret, dizin siteleri, haber portalları).

- Sık içerik güncellemesi yapan siteler – Yeni sayfaların hızlı şekilde dizine eklenmesi gereken bloglar veya haber siteleri.

- Yeni web siteleri – Arama motorlarının tüm önemli sayfaları keşfedip dizine eklemesini sağlamak için.

- Düşük değerli sayfaların yoğun olduğu siteler – Çok sayıda önemsiz URL’ye sahip sitelerde (örn. filtreli gezinme, kopya sayfalar) Google, crawl budget’ı bu sayfalara harcayarak öncelikli içeriklere ulaşamayabilir.

Siteniz etkili şekilde taranmıyorsa, önemli sayfalar arama sonuçlarında (SERP) yer almayabilir. Bu da organik trafik ve sıralamaları olumsuz etkiler.

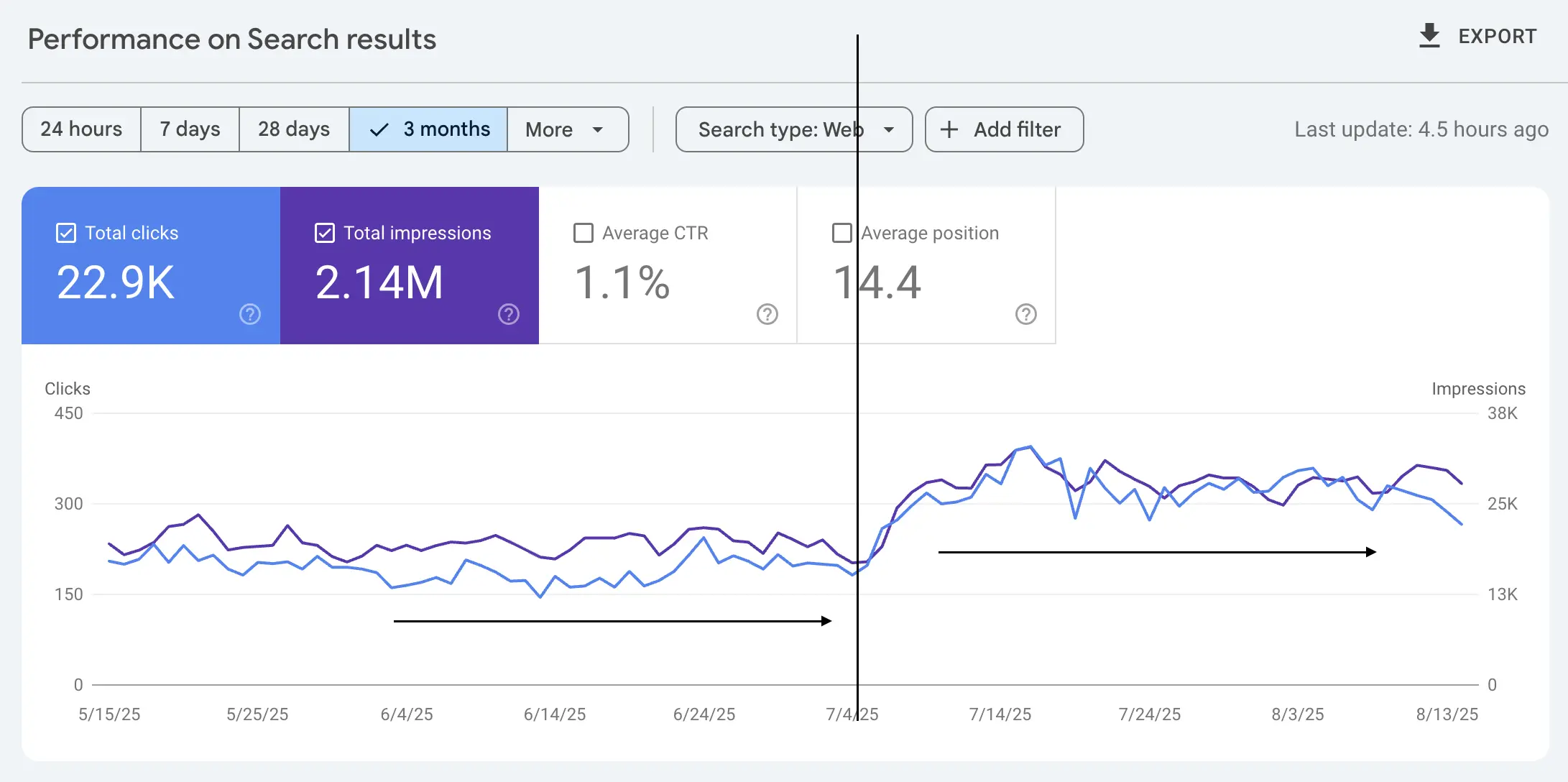

Crawl budget ile SEO performansı (buna yapılan optimizasyonlar olarak bakabilirsiniz) arasındaki ilişki, özellikle büyük ölçekli sitelerde net biçimde görülür. Binlerce ürün sayfasına sahip e-ticaret siteleri, her gün çok sayıda içerik yayınlayan haber portalları ve geniş kategori yapısına sahip dizin siteleri, kendilerine özgü crawl budget zorluklarıyla karşılaşır. Bu sitelerin arama motorlarını en değerli içeriklerine yönlendirmeleri gerekir.

Tarama aktivitesi verilerini analiz etmek, optimizasyon fırsatlarını belirlemeye yardımcı olur. Hızlı büyüyen, mevsimsel içerik değişiklikleri yaşayan veya ürünlerini sıkça güncelleyen siteler, yeni içeriklerin hızla keşfedilmesi için proaktif şekilde crawl budget yönetimi yapmalıdır. Aksi halde, değerli sayfalar haftalarca hatta aylarca keşfedilmeden kalabilir ve bu durum potansiyel organik trafiği ciddi ölçüde azaltır.

Tarama Bütçesi, Kime ‘Geçrekten’ Ne Kadar Önemli?

Arama motoru optimizasyonu uzmanları arasında uzun süredir devam eden bir yanılgı, her web sitesinin sabit bir “tarama bütçesi”ne sahip olduğu yönündedir. Google’ın arama ilişkileri ekibinden John Mueller ve Gary Illyes gibi isimler, bu kavramın esasen milyonlarca sayfaya sahip devasa siteler (büyük e-ticaret siteleri, haber portalları gibi) için geçerli olduğunu defalarca açıklamıştır. Google, doğası gereği sonsuz sayıdaki URL’in hepsini keşfedemez ve dizine ekleyemez. İşte bu nedenle, kısıtlı kaynaklarını en değerli ve kullanıcılar için faydalı olan sitelere ayırır.

Küçük ve orta ölçekli siteler için, Googlebot’un siteyi nadiren ziyaret etmesi genellikle bir teknik “kapasite” sorunu değil, daha çok bir “tarama talebi” düşüklüğü sorunudur. Başka bir deyişle, Googlebot sitenizi yavaş tarıyorsa, bunun nedeni çoğunlukla sunucunuzun yavaş olması ya da sitenizde Google’ın zaman ayırmaya değer gördüğü, yeterince yüksek kaliteli ve güncel içeriğin bulunmamasıdır. Sorun, tarama bütçesinin kendisi değil, onu etkileyen altta yatan diğer faktörlerdir.

Sayfa hızı gibi bir teknik bileşenin, sadece Googlebot’un sitenizi hızlı taramasıyla kalmayıp aynı zamanda kullanıcı deneyimini de iyileştirdiği bir gerçektir. Googlebot, web’i tararken bir kullanıcının deneyimini taklit eder. Hızlı yüklenen, hatasız sayfalar Googlebot’un zamanını verimli kullanmasını sağlar ve sitenizin genel sağlığı hakkında olumlu sinyaller verir.

Bu verimlilik, Google’ın sitenize ayırdığı “tarama hızı” limitini artırabilir. Aynı zamanda, hızlı siteler daha iyi kullanıcı deneyimi sunduğu için kullanıcı etkileşimi artar. Artan kullanıcı etkileşimi ise Google’a sitenin popüler ve değerli olduğu sinyalini vererek “tarama talebini” güçlendirir. Bu iki faktör bir araya gelerek sitenizin arama motorları nezdindeki değerini sürekli olarak artıran bir döngüsel fayda oluşturur.

Hangi Siteler Gerçekten Endişelenmeli?

Tarama bütçesi optimizasyonu, her sitenin ajandasında en üst sırada yer alması gereken bir konu değildir. Bu konuya odaklanmak, en az 10.000, hatta 500.000’den fazla sayfaya sahip siteler, günlük olarak yeni içerik ekleyen haber siteleri, stokları sürekli değişen büyük e-ticaret platformları gibi siteler için hayati önem taşır.

Küçük ve orta ölçekli siteler için öncelik, daha çok yüksek kaliteli ve kullanıcı odaklı içerik üretmek, güçlü bir dahili bağlantı yapısı kurmak ve temel site hızını optimize etmektir. Googlebot’un sitenizi hızlıca gezip, değerli içeriğinizi kolayca bulmasını sağlamak, bütçeyi artırmanın en etkili yoludur.

Ek olarak küçük bir web siteniz var ise Google Index API’i web sitenize kurabilir ve hızlıca index almak için bu yolu izleyebilirsiniz (oldukça etkilidir).

Tarama Bütçenizi Olumsuz Etkileyen Faktörler Nelerdir?

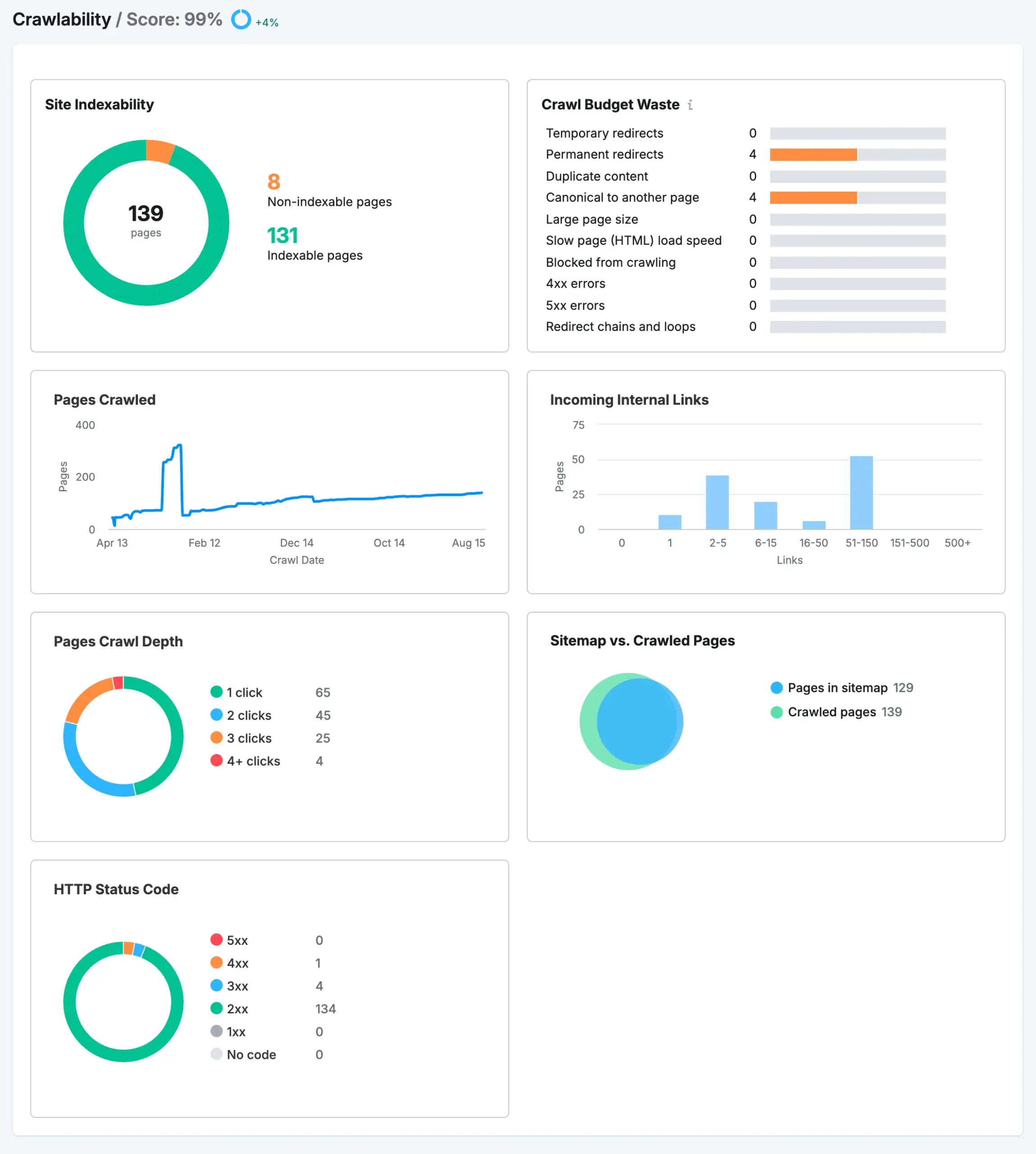

Tarama bütçesi, bir sitenin genel teknik ve içerik sağlığının bir yansımasıdır. Google’ın sitenize ne kadar zaman ayıracağını belirleyen birçok faktör vardır. Bunları üç ana başlık altında inceleyebiliriz.

Teknik ve Altyapı Faktörleri

- Sunucu Performansı ve Site Hızı: Googlebot, sitenize istek gönderdiğinde, sunucunuzun yanıt süresi kritik bir rol oynar. Yavaş yanıt veren sunucular, Googlebot’un sitenizde daha az sayfa taramasına neden olur. Yüksek sayfa yükleme süreleri de benzer bir etki yaratır, botun her sayfa için harcadığı zamanı artırır ve toplam tarama sayısını düşürür.

Google, daha hızlı sitelerin daha fazla sayfa tarandığını ve bunun kullanıcı deneyimiyle doğrudan ilişkili olduğunu belirtiyor. İçerik Dağıtım Ağı (CDN) kullanmak, sunucu konfigürasyonunu optimize etmek gibi önlemler, bu sorunu çözmede yardımcı olabilir. - Hatalar ve Sorunlar: Sitenizdeki teknik hatalar, tarama bütçesinin boşa harcanmasının en yaygın nedenlerinden biridir. Sunucu hataları (5xx) veya bulunamayan sayfalar (404), Googlebot’un sitenizde değerli sayfalar yerine hatalı sayfalara zaman harcamasına neden olur. Özellikle “soft 404” olarak adlandırılan, aslında olmayan bir sayfanın 200 (başarılı) durum koduyla yanıt vermesi durumu, Googlebot’un sitenizdeki bu tür hatalı sayfaları taramaya devam etmesine ve kaynak israfına yol açar.

Site Yapısı Faktörleri

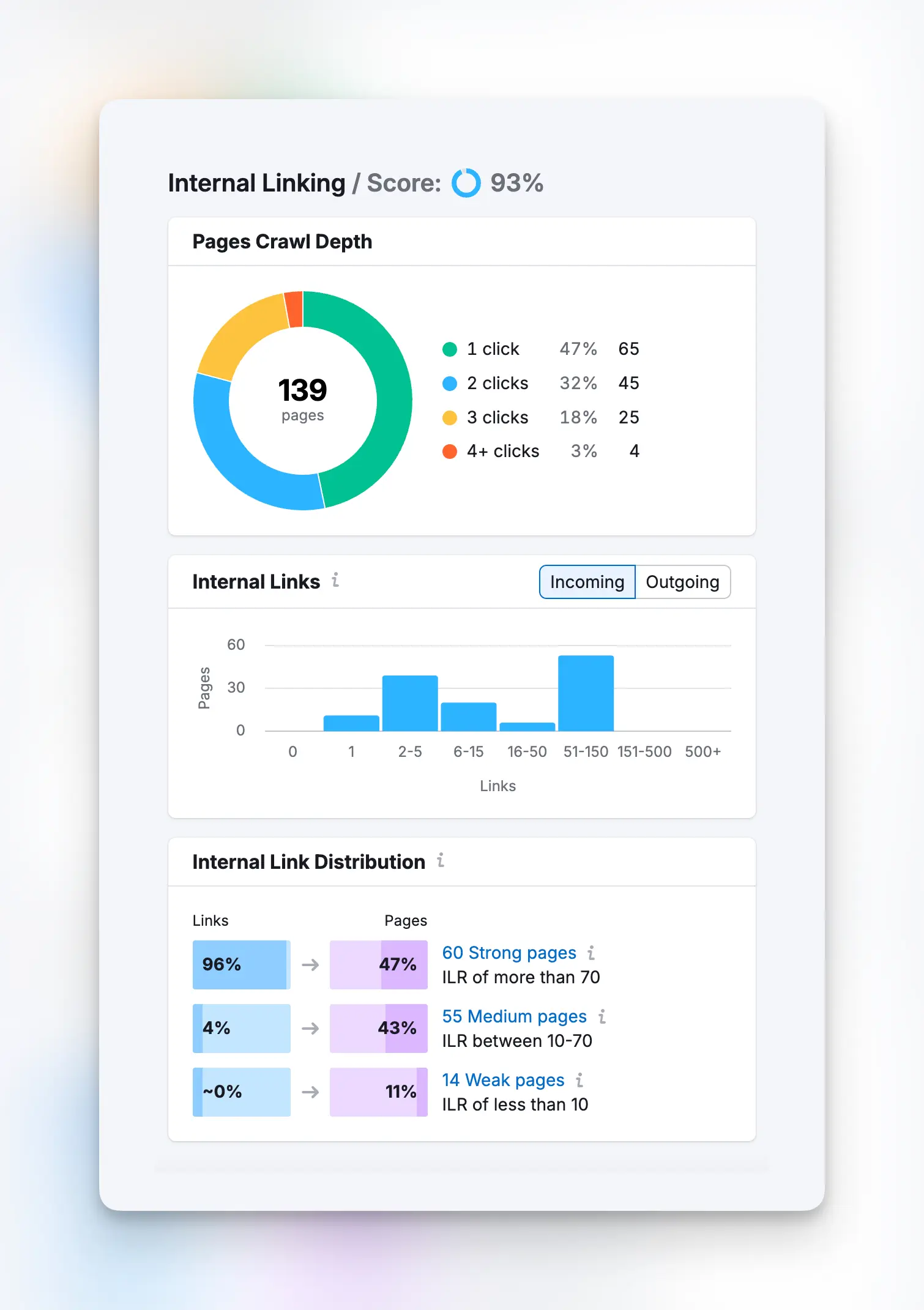

- Dahili Bağlantı Yapısı: Sitenizin dahili bağlantı mimarisi, bir harita gibi Googlebot’a hangi sayfaların önemli olduğunu gösterir. Sayfalarınızın ana sayfaya olan yakınlığı ve aldığı dahili link sayısı, Google’ın o sayfaların önemini anlamasına yardımcı olur. Dahili linki olmayan sayfalara “yetim sayfalar” (orphan pages) denir. Googlebot’un bu sayfaları keşfetmesi çok zordur, bu da tarama bütçesinin israfına yol açar çünkü bot bu sayfaları bulamaz.

- URL Yapısı ve Parametreler: Karmaşık URL’ler, oturum kimlikleri (?sessionid=123) ve sonsuz filtreleme kombinasyonları, sitenizde binlerce gereksiz ve düşük kaliteli URL oluşmasına neden olabilir. Örneğin, bir e-ticaret sitesindeki renk, beden veya fiyata göre yapılan filtreler, aynı içeriğe sahip ancak farklı URL’lere sahip sayfalar oluşturabilir. Googlebot, bu sayfaları tek tek taramak zorunda kalır ve tarama bütçesi bu gereksiz iş için harcanır.

İçerik Kalitesi Faktörleri

- Yinelenen İçerik (Duplicate Content): Aynı içeriğe sahip birden fazla sayfanın taranması, Googlebot’un zamanını ve kaynaklarını boşa harcayan en büyük sorunlardan biridir. Google, aynı içeriği tekrar tekrar taramak ve dizine eklemek istemediği için, bu durum tarama bütçesinin israfına neden olur. Ancak bu sorunun etkisi, sadece tarama bütçesi israfıyla sınırlı değildir. Çoğaltılmış (ya da yinelenen) içerik, Google’ın hangi versiyonu dizine ekleyeceğini belirleyememesine yol açarak arama sonuçlarında “kanibalizasyon” olarak bilinen bir soruna da neden olabilir. Bu, en doğru sayfanın arama sonuçlarında gösterilmesini engeller ve sıralamaları olumsuz etkileyebilir.

- Düşük Kaliteli İçerik: Google, düşük değerli, spam veya anahtar kelime doldurulmuş sayfaları daha az tarama eğilimindedir. Google’ın arama mühendisleri, yüksek kaliteli ve kullanıcı odaklı içeriğin tarama talebini doğrudan artırdığını ve en iyi yolun bu olduğunu vurgulamaktadır. Sitenizin sunduğu değer ne kadar yüksekse, Google’ın sitenize olan ilgisi ve dolayısıyla tarama talebi de o kadar artar.

Tarama Bütçesi Optimizasyonu Nasıl Yapılır?

Tarama bütçesi optimizasyonunun amacı, Googlebot’u sitenizin en değerli sayfalarına yönlendirerek kaynak israfını önlemektir. Bu, hem sitenizin daha hızlı indekslenmesini sağlar hem de genel SEO performansınızı iyileştirir.

Temel Teknik İyileştirmeler

Robots.txt ile Akıllı Engelleme

robots.txt dosyası, Googlebot gibi tarayıcılara sitenizin hangi bölümlerini tarayabileceğini veya tarayamayacağını söyleyen bir talimat dosyasıdır. Bu dosyayı tarama bütçesi israfını önlemek için son derece akıllıca kullanmalısınız. Örneğin, sitenizin iç arama sonuçları, filtreleme sayfaları, yönetici paneli sayfaları veya parametrelerle oluşturulan gereksiz URL’leri

Disallow direktifiyle engelleyebilirsiniz. Bu sayede, Googlebot’un zamanını ve enerjisini, kullanıcılar için gerçek değer taşıyan sayfalarınıza harcamasını sağlarsınız.

Uzman Bilgisi: robots.txt ile noindex etiketinin farkını iyi anlamalısınız. robots.txt dosyası, Google’ın sayfayı istemesini ve taramasını engellerken, noindex etiketi Google’ın sayfayı istemesine ancak taradıktan sonra dizine eklememesine neden olur.

noindex etiketi, botun sayfayı okuması gerektiği için tarama bütçesini boşa harcar. Dolayısıyla, bir sayfanın hem dizine eklenmesini hem de taranmasını istemiyorsanız, en verimli yöntem robots.txt kullanmaktır.

Bazı sayfalar hiç taranmamalıdır, örneğin:

- Yönetici veya giriş (admin/login) sayfaları

- Yinelenen sayfalar (örn. etiket sayfaları, arama sonuç sayfaları)

- Filtreleme ile oluşan çoklu URL’ler (faceted navigation)

İstenmeyen URL’lerin taranmasını engellemek için robots.txt dosyasını kullanın.

User-agent: Googlebot

Disallow: /wp-admin/

Disallow: /search-results/

Disallow: /filter/⚠️ Not: Robots.txt ile bir sayfayı engellemek, sayfanın dizine eklenmeyeceği anlamına gelmez. Bunun için sayfada “noindex” meta etiketi kullanın.

XML Sitemap’lerinizi Güçlendirin

XML sitemaps, Google’a sitenizdeki en önemli sayfaların bir yol haritasını sunar. Ancak birçok web yöneticisi bu dosyaya her URL’i ekleyerek bir hata yapar. Etkili bir sitemap stratejisi, sadece dizine eklenmesini istediğiniz, yüksek kaliteli ve

200 HTTP durum kodu veren sayfaları içermelidir.

<lastmod> etiketiyle bir sayfanın en son ne zaman güncellendiğini belirterek, Google’a bu sayfayı yeniden taraması için bir sinyal gönderebilirsiniz. Bu, güncel içeriğinizin daha hızlı indekslenmesine yardımcı olur.

XML Sitemap’i Optimize Edin

XML sitemap, Googlebot’un sitenizdeki önemli sayfaları bulmasına yardımcı olur.

- Sitemap’te yalnızca yüksek kaliteli URL’ler yer almalıdır.

- Yinelenen (duplicate), yönlendirilmiş (redirect) veya “noindex” etiketi olan sayfaları sitemap’e eklemeyin.

- Sitemap’i Google Search Console üzerinden gönderin.

Optimize edilmiş bir sitemap örneği:

<urlset xmlns="http://www.sitemaps.org/schemas/sitemap/0.9">

<url>

<loc>https://www.siteadi.com/hakkimizda</loc>

<lastmod>[year]-06-04</lastmod>

<priority>1.0</priority>

</url>

</urlset>Yönlendirme Zincirleri ve Kırık Bağlantılardan Kurtulun

Uzun yönlendirme zincirleri (URL A -> URL B -> URL C) Googlebot’un zamanını boşa harcar ve sayfa yükleme sürelerini uzatır. Her bir yönlendirme, bot için ek bir “sıçrama” anlamına gelir ve bu sıçramalar çok fazla olduğunda bot, zincirin sonuna ulaşmadan taramayı bırakabilir. En iyi uygulama, zincirdeki ilk URL’den doğrudan son URL’ye 301 yönlendirmesi yapmaktır. Kırık bağlantılar (404 sayfasına giden linkler) da benzer şekilde tarama bütçesinin verimsiz kullanılmasına neden olur ve Google’a sitenizin güncel olmadığı sinyalini verir.

İçerik ve Site Yapısı Stratejileri

Dahili Bağlantı Yönetimi

Sitenizin güçlü bir dahili bağlantı yapısı, en önemli sayfalarınızın Googlebot tarafından kolayca keşfedilmesini ve daha sık taranmasını sağlar. Ana sayfanızdan veya yüksek trafik alan sayfalarınızdan, dizine eklenmesini istediğiniz derin sayfalara linkler vererek Google’ın botlarına bir önceliklendirme haritası sunmuş olursunuz. Yetim sayfaları, yani dahili link almayan sayfaları tespit edip onlara uygun linkler vererek bu sorunu çözmelisiniz.

Önemli Sayfaların Dizine Eklenmesini Önceliklendirin

Web sitenizdeki tüm sayfalar aynı değerde değildir; bazıları arama motorlarında görünmek için kritik öneme sahiptir. Bu nedenle, sadece gerçekten değerli sayfaların dizine eklenmesini sağlayın:

- Ana açılış sayfaları, hizmet sayfaları ve blog içerikleri dizine eklenmeli.

- Google’ın sitenizi nasıl taradığını ve hangi sayfaların dizine alındığını görmek için Google Search Console > Index Coverage Report’u düzenli olarak kontrol edin.

- Arama sonuçlarında görünmesi gerekmeyen sayfalar (örn. özel filtre sayfaları, eski kampanya sayfaları) için “noindex” meta etiketi kullanın.

- Sayfaların önemini artırmak için iç linkleme ile önceliklendirme yapın; örneğin en değerli sayfalara daha fazla içerik bağlantısı verin.

Bu yaklaşım, arama motorlarının crawl budget’ını en değerli sayfalara odaklamasını sağlar ve dizine eklenmeyen düşük değerli içeriklerin SEO performansınızı gölgelemesini önler.

Site Mimarisi ile Tarama ve Dizine Eklenme Performansını Artırın

İyi planlanmış bir site yapısı, arama motorlarının sitenizi hızlı ve doğru şekilde taramasını sağlar:

- Düz ve sade bir URL yapısı kullanın. Örn. /kategori/alt-kategori/sayfa gibi derin URL’lerden kaçının.

- Önemli sayfalar, anasayfadan maksimum 3 tık uzaklıkta olmalı; böylece Googlebot bu sayfalara hızlıca ulaşır.

- İç linkleme stratejisi ile arama motorlarını yönlendirin: Önemli sayfalara sitenin diğer bölümlerinden mantıklı ve anlamlı linkler verin.

- Kategori ve etiket sayfalarını yalnızca gerekli olduğunda kullanın; gereksiz sayfalar crawl budget’ı tüketebilir.

Bu yapı, sitenizin hem kullanıcı deneyimini hem de arama motoru erişilebilirliğini güçlendirir, yeni içeriklerin hızlıca dizine eklenmesini sağlar ve SEO performansınızı artırır.

URL Yönetimi ve Çoğaltılmış/Yinelenen İçerik Sorunu

URL parametrelerinin yarattığı çoğaltılmış içerik sorunu, canonical etiketleri kullanılarak etkili bir şekilde yönetilebilir. Bu etiketler, Google’a benzer içeriğe sahip sayfalar arasından hangisinin “ana” sayfa olduğunu söyler ve tarama bütçesinin boşa harcanmasını önler. Bu yaklaşım, özellikle büyük e-ticaret sitelerinde filtreleme ve sıralama kombinasyonlarının yol açtığı URL karmaşasını çözmek için hayati önem taşır.

Yinelenen İçerik Sorunlarını Önleyin.

Yinelenen içerik, arama motorlarını yanıltır ve crawl budget’ınızı boşa harcar.

- Sayfaların tercih edilen sürümünü belirtmek için canonical etiketleri (rel=”canonical”) kullanın.

- Gereksiz URL varyasyonlarından kaçının (örn. HTTP yerine HTTPS, www yerine non-www).

Pratik Uygulama – JavaScript Ağır Siteler

Modern web sitelerinin çoğu JavaScript tabanlıdır. Kaynaklar, JavaScript’in taranmasının daha uzun sürdüğünü ve tarama bütçesini normal bir HTML sayfasına göre 9 kata kadar daha fazla tüketebileceğini belirtiyor.

Bunun nedeni, Googlebot’un JS tabanlı bir sayfayı tararken önce istemesi, sonra render etmesi ve son olarak dizine eklemesi gibi ek adımlar gerektirmesidir. Geleneksel HTML sayfaları için bu ek adımlara gerek yoktur.

Bu nedenle, JavaScript ağırlıklı sitelerde sunucu tarafı renderlama (SSR) gibi çözümlerin uygulanması, botların işini kolaylaştırır ve tarama bütçesi verimliliğini inanılmaz derecede artırır.

| Özellik | Tarama Hızı (Crawl Rate) | Tarama Talebi (Crawl Demand) |

|---|---|---|

| Tanım | Googlebot’un sunucunuza yapabileceği istek sayısı ve frekansı | Google’ın sitenizi ne sıklıkta ve ne kadar derinlemesine taramak istediği |

| Belirleyen Faktörler | Sunucu hızı, site performansı, sunucu hataları (4xx/5xx) | Sitenin popülaritesi, içerik kalitesi, güncellenme sıklığı |

| Ana Hedef | Googlebot’un sitenizi aşırı yüklemesini engellemek ve botun işini kolaylaştırmak | Google’ı sitenizdeki içeriğin değerli olduğuna ikna etmek |

| Pratik Etki | Hızlı sunucular daha yüksek bir tarama hızı limitine sahip olur | Yüksek kaliteli ve popüler siteler daha sık taranır |

Tarama Bütçenizi Nasıl Ölçer ve Analiz Edersiniz?

Tarama bütçenizi optimize etmek, sadece tahmini iyileştirmeler yapmakla kalmaz; aynı zamanda bu iyileştirmelerin etkisini ölçmekle de ilgilidir. İki ana araçla Googlebot’un sitenizdeki gerçek davranışını derinlemesine analiz edebilirsiniz.

Google Search Console (GSC) Tarama İstatistikleri Raporu

Google Search Console, sitenizin tarama istatistiklerini izlemeniz için ücretsiz ve vazgeçilmez bir araçtır. Bu rapora Ayarlar > Tarama İstatistikleri üzerinden erişebilirsiniz. Raporda, son 90 gün içindeki tarama davranışlarına ilişkin şu verileri bulabilirsiniz:

- Toplam Tarama İsteği: Google’ın sitenize yaptığı toplam tarama isteği sayısı.

- Toplam İndirme Boyutu: Google’ın sitenizden indirdiği toplam veri miktarı.

- Ortalama Yanıt Süresi: Sunucunuzun Googlebot’un isteklerine ortalama ne kadar sürede yanıt verdiği.

- Ana Bilgisayar Durumu: Sunucunuzun tarama isteklerini başarılı bir şekilde karşılayıp karşılamadığına dair genel durum.

Bu veriler, sitenizin tarama performansı hakkında değerli ipuçları sunar. Örneğin, “Ortalama Yanıt Süresi” grafiğiniz yükselirken “Toplam Tarama İsteği” düşüyorsa, bu, sunucunuzun yavaşladığı ve Googlebot’un tarama hızını düşürdüğü anlamına gelir. Bu bir tarama hızı problemidir. Bu veriyi görerek, sunucu performansı iyileştirmelerine odaklanma kararı alabilirsiniz.

Tam buradayken şu soruya da bir cevap vermek isterim;

Google’ın Bir Sayfayı Taraması Ne Kadar Sürer?

Google’ın sayfaları tarama süresi sabit değildir; tarama önceliğe göre gerçekleşir:

- Yeni web siteleri: İlk tarama günler veya haftalar sürebilir.

- Köklü siteler: Yüksek öncelikli sayfalar saatler veya günler içinde taranabilir.

- Düşük öncelikli sayfalar: Yeniden taranması haftalar veya aylar sürebilir.

Crawl hızını etkileyen faktörler: site otoritesi, iç linkleme yapısı ve içerik tazeliği.

Crawl zamanlamasını anlamak, içerik yayınlama ve optimizasyon stratejileri için gerçekçi hedefler belirlemeye yardımcı olur. Yüksek otoriteye sahip siteler ve güçlü crawl budget’ı olan siteler, yeni içeriklerini daha hızlı keşfedip dizine eklenmesini bekleyebilir; yeni siteler ise benzer sonuçlar için sabır ve stratejik optimizasyon gerektirir.

Ayrıca, içerik tazeliği sinyalleri crawl hızını etkiler: yayın tarihleri, güncelleme zaman damgaları ve sosyal etkileşim metrikleri gibi göstergeler, arama motorlarının sayfaları önceliklendirmesinde rol oynar. Son zamanlarda güncellenmiş ve kullanıcıya sürekli değer sunan içerikler, daha sık taranır. Bu sinyallerin stratejik olarak uygulanması, önemli sayfaların tarama sıklığını artırabilir.

Log Dosyası Analizi

GSC’deki veriler harika bir başlangıç noktası olsa da, log dosyası analizi, bir adım öteye geçerek Googlebot’un sitenizdeki gerçek zamanlı ve tarihsel davranışını anlama fırsatı sunar. Web sunucunuz tarafından tutulan log dosyaları, her bir botun hangi sayfaları ne zaman, ne sıklıkta taradığına, hangi durum kodlarını (200, 301, 404 vb.) aldığına dair ayrıntılı bilgiler içerir.

Log analizi ile şu gibi hayati bilgileri ortaya çıkarabilirsiniz:

- Aşırı Tarama: Düşük değerli, parametreli veya çoğaltılmış içerik sayfalarının Googlebot tarafından gereğinden fazla tarandığını tespit edebilirsiniz. Örneğin, loglarınızda bir arama sorgusu sayfasının yüz binlerce kez tarandığını görmek, tarama bütçesi israfının somut bir kanıtıdır. Bu veriyi kullanarak, bu tür URL’leri

robots.txtile engelleme stratejisi geliştirebilirsiniz. - Gözden Kaçan Sayfalar: Önemli ve trafik getiren sayfalarınızın botlar tarafından yeterince sık ziyaret edilmediğini belirleyebilirsiniz.

- Sunucu Hataları: Sıkça yaşanan 404 veya 5xx gibi sunucu hatalarını hangi URL’lerin tetiklediğini hızlıca tespit edebilirsiniz.

Log dosyası analizi, GSC ve diğer araçların sunduğu genel tabloya kıyasla daha ayrıntılı ve eyleme geçirilebilir veriler sunar. Semrush Log File Analyzer, Botify ve Screaming Frog gibi SEO araçları, bu verileri yorumlamanıza ve stratejinizi şekillendirmenize yardımcı olabilir.

Gelişmiş Crawl Budget Optimizasyonu Teknikleri

Temel optimizasyon stratejilerinin ötesinde, gelişmiş crawl budget yönetimi teknik SEO unsurları ile arama motoru davranışları arasındaki karmaşık etkileşimleri anlamayı gerektirir.

- Yapısal veri (structured data) kullanımı, içeriklerin önemini ve sayfalar arası ilişkileri arama motorlarına net bir şekilde ileterek crawl talebini (crawl demand) etkileyebilir.

- Farklı arama motorlarındaki tarama aktivitelerini izlemek, farklı crawl davranışları ve öncelikleri hakkında bilgi verir. Örneğin Google bazı içerik türlerini önceliklendirirken, Bing farklı sayfa özelliklerine odaklanabilir. Bu farkları anlamak, çoklu arama motorlarında görünürlüğü maksimize eden kapsamlı optimizasyon stratejileri geliştirmeye yardımcı olur.

Ayrıca, sunucu tarafı optimizasyonu, crawl budget verimliliğinde kritik bir rol oynar:

- Veritabanı sorgularını optimize etmek

- Sunucu yanıt sürelerini iyileştirmek

- İçerik dağıtım ağları (CDN) kullanmak

gibi teknik iyileştirmeler, crawl limitinizi önemli ölçüde artırır. Bu tür geliştirmeler, sürdürülebilir bir crawl budget optimizasyonu için sağlam bir temel oluşturur.

Farklı İçerik Türleri İçin Crawl Budget Yönetimi

Farklı içerik türleri, özelleştirilmiş crawl budget stratejileri gerektirir:

- Haber siteleri: Zaman duyarlı içerikler için agresif crawl optimizasyonu yapılmalıdır; böylece son dakika haberleri hızlıca dizine eklenir.

- E-ticaret platformları: Ürün sayfalarının taranması ile kategori navigasyonu ve kullanıcı tarafından oluşturulan içerikler arasında denge kurulmalıdır.

- Blog siteleri: Stratejik iç linkleme ve içerik tazeliğini gösteren sinyaller, düzenli tarama aktivitesini teşvik eder.

Arama motorlarının içerik tazeliği, kullanıcı etkileşimi ve konu ile alaka düzeyi gibi kriterleri nasıl değerlendirdiğini anlamak, belirli içerik kategorileri için crawl talebini (crawl demand) optimize etmeye yardımcı olur.

Ayrıca:

- Sosyal medya entegrasyonu ve dış link inşası (backlink), içerik popülerliği ve otoritesini göstererek crawl talebini artırabilir.

- Yüksek sosyal etkileşim alan veya kaliteli backlink’e sahip sayfalar, arama motorları tarafından değerli kabul edilerek daha sık taranır.

Farklı Arama Motorlarında Crawl Budget Etkisi

Google, arama trafiğinde baskın olsa da, farklı arama motorlarında crawl budget etkilerini anlamak, kapsamlı optimizasyon avantajları sağlar.

- Bing tarayıcıları, Google’dan farklı davranış kalıpları gösterir ve sıralama faktörlerinde farklı öncelikler kullanabilir.

- Baidu, Yandex gibi uluslararası arama motorları ve bölgesel platformlar, her biri kendine özgü crawl budget özellikleri ve optimizasyon gereksinimleri taşır. Küresel hedef kitleye sahip siteler, strateji geliştirirken bu farklılıkları dikkate almalıdır.

Arama motoru tarayıcıları, kullanıcı davranışları, teknolojik gelişmeler ve rekabet baskılarına bağlı olarak algoritmalarını ve tarama kalıplarını sürekli olarak günceller. Crawler güncellemeleri ve algoritma değişikliklerinden haberdar olmak, crawl budget optimizasyonunun uzun vadede etkin kalmasını sağlar.

Daha İyi SEO İçin Crawl Budget Optimizasyonu Şarttır.

Crawl budget, özellikle büyük ve karmaşık web siteleri için SEO’da kritik bir rol oynar. Googlebot’un önemsiz sayfalarda fazla zaman harcaması, en önemli sayfalarınızın taranmaması veya dizine eklenmemesi riskini doğurur.

Bu stratejileri uygulayarak—site mimarisini optimize etmek, gereksiz URL’leri engellemek, kırık linkleri düzeltmek, sayfa yükleme hızını artırmak ve iç linklemeyi iyileştirmek—Google’ın doğru sayfaları verimli şekilde taramasını sağlayabilirsiniz.

İyi optimize edilmiş bir crawl budget, şunları sağlar:

- Daha hızlı dizine ekleme

- Daha iyi arama sıralamaları

- Artan organik trafik

Başarılı crawl budget optimizasyonu, sürekli dikkat ve düzenli iyileştirme gerektirir; performans verileri ve arama motoru algoritma güncellemelerine dayalı olarak stratejiler sürekli revize edilmelidir. Doğru yönetilen crawl budget, arama görünürlüğünü artırır, içeriklerin hızlı keşfedilmesini sağlar ve genel SEO performansını güçlendirir.

Unutmayın! Crawl budget optimizasyonu tek seferlik bir işlem değil, web sitenizin büyümesi ve arama motoru gereksinimlerinin değişmesiyle evrilen sürekli bir süreçtir. Düzenli izleme, test etme ve strateji ayarlamaları, sürdürülebilir SEO başarısı ve arama sonuçlarında rekabet avantajı sağlar.

Yinede, tarama bütçenizi doğru yönetmek, SEO çalışmalarınızın temel taşlarından biridir. Eğer web sitenizin Google tarafından daha verimli taranmasını ve arama sonuçlarında öne çıkmasını istiyorsanız, benden profesyonel SEO hizmetleri alarak süreci hızlandırabilirsiniz.

Ahmet Abiç, SEO uzmanı ve dijital strateji danışmanıdır. Teknik SEO, içerik stratejisi ve veri odaklı büyüme modelleri üzerine çalışır. Türkiye ve uluslararası projelerde markaların organik görünürlüğünü artırmaya yardımcı olur ve SEO'yu sadece sıralama değil sürdürülebilir dijital büyüme aracı olarak görür.

Paylaşarak başkalarının da faydalanmasına yardımcı olun.